O Abismo entre a Expectativa e a Realidade Técnica

Em 2026, a maturidade da engenharia exige que abandonemos definitivamente o “vibe coding” em favor de padrões determinísticos.

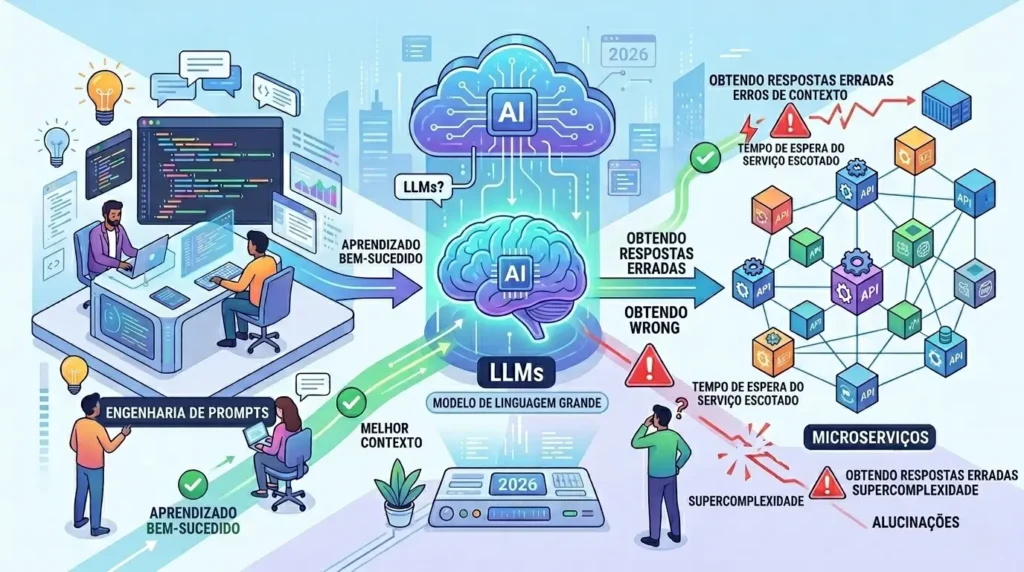

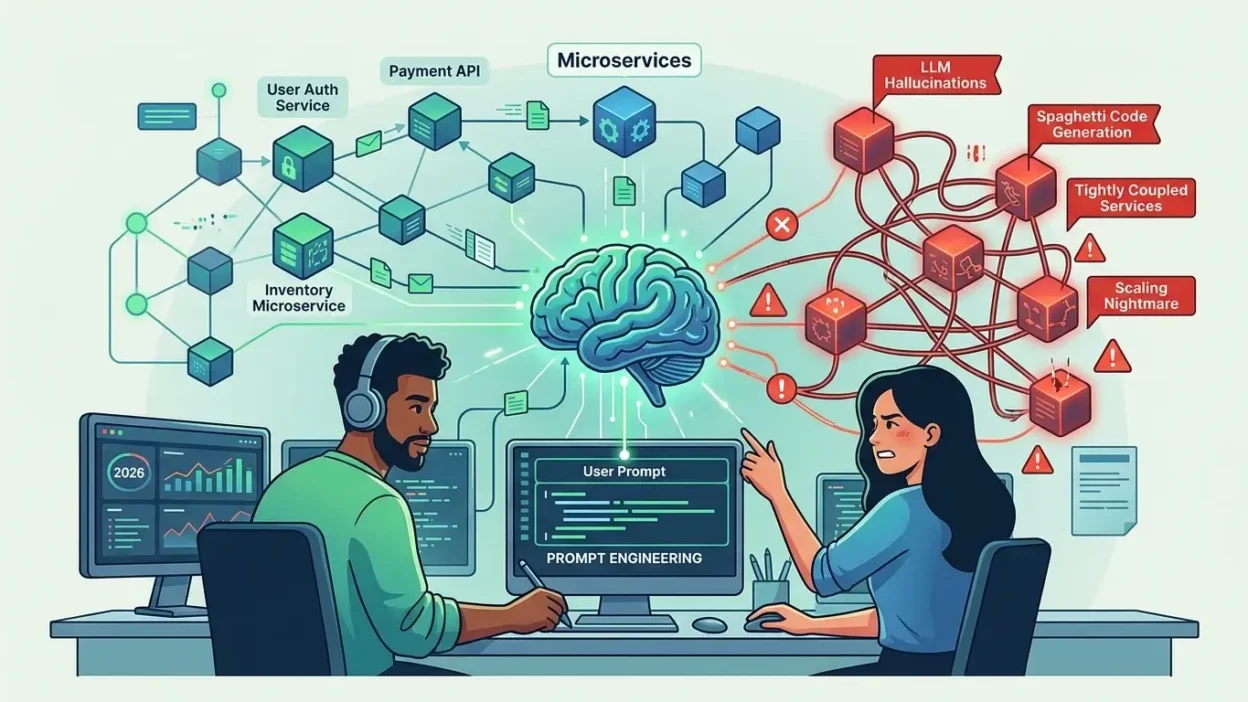

O cenário atual é marcado pelo que chamamos de Operational Gap: um abismo crescente entre a promessa de “mágica” das IAs generativas e a complexidade operacional de microserviços em larga escala.

Afinal, desenvolvedores que buscam escalabilidade infinita ou respostas perfeitas sem rigor estrutural acabam presos em resultados inconsistentes.

Para o Estrategista de Conteúdo e o Arquiteto, o desafio não é apenas adotar a tecnologia, mas fechar essa lacuna operacional com precisão técnica e governança.

Resumo em áudio:

A Lição do “Desenhe um Gato”: Por que a Especificidade é sua Melhor Ferramenta

O erro mais comum na interação com LLMs é a vagueza.

O exemplo “desenhe um gato” ilustra perfeitamente um prompt mal desenhado: sem diretrizes, a variância estatística é total.

Se você precisa de um gato preto, sorrindo e com uma gravata borboleta vermelha, a especificidade é a única forma de alinhar o output à sua expectativa.

No desenvolvimento, isso se traduz em frustrações ao pedir, por exemplo, um “sistema de autenticação”.

Sem questionar: “Quantos usuários teremos? É uma arquitetura de microserviços?

Usaremos OAuth, JWT ou sessões?”, o desenvolvedor está apenas delegando a incerteza para a máquina.

Para transformar prompts em ferramentas de engenharia confiáveis, você deve integrar quatro componentes:

- Instrução Clara: Defina a ação exata (ex: “Construa um app de lista de tarefas com calendário e remoção automática de itens marcados”).

- Contexto: Forneça o domínio necessário (ex: “O usuário é um engenheiro sênior de backend trabalhando com sistemas distribuídos”).

- Restrições: Estabeleça os limites do “não fazer” (ex: “Foque apenas em causas a nível de sistema; não sugira correções, apenas diagnostique”).

- Formato de Saída: Especifique a estrutura (ex: JSON com chaves “root_cause” e “confidence”).

“A engenharia de um bom prompt reduz a variância e aumenta a confiabilidade.”

A Hierarquia de Poder nos LLMs: Quem Realmente Comanda o Output?

LLMs não são leitores de mentes, mas analisadores de padrões estatísticos que operam através de self-supervised learning.

Durante o treinamento, eles aprendem sintaxe, semântica e contexto ao prever o próximo token em volumes massivos de dados.

Ao processar seu input, o modelo segue uma hierarquia de pesos rigorosa:

- Instruções do Sistema: Onde se define o comportamento base e as diretrizes de segurança.

- Instruções do Desenvolvedor: Onde o contexto técnico e as regras de negócio são injetados.

- Input do Usuário: A última camada, que possui o menor peso relativo no processamento.

Entender que o modelo busca padrões estatísticos ajuda a perceber que o prompt não é uma conversa, mas um exercício de redução de espaço amostral para encontrar a resposta correta dentro dos parâmetros aprendidos.

A Lei de Conway e o Verdadeiro Propósito dos Microserviços

Em 2026, entendemos que microserviços servem para escalar a organização antes de escalar o sistema.

A “Regra das Duas Pizzas” de Jeff Bezos continua sendo a métrica de ouro: equipes ideais possuem entre 4 a 5 pessoas.

Quando uma equipe ultrapassa esse limite, o custo de coordenação explode, gerando o que chamamos de “contenda de entrega” (delivery contention).

Ao adotar microserviços alinhados a capacidades de negócio, as empresas aplicam a Lei de Conway de forma estratégica: a arquitetura do software passa a refletir a estrutura de comunicação desejada.

Isso quebra silos e permite que pequenos times cross-funcionais gerenciem todo o ciclo de vida de um serviço, da interface ao armazenamento persistente, com autonomia real.

“Microserviços ajudam a quebrar as fronteiras de Conway, alinhando a arquitetura do sistema à estrutura de comunicação da organização.”

Padrões de Prompting que Você Deve Dominar

Para sair do amadorismo, o desenvolvedor deve dominar padrões que garantem previsibilidade.

Abaixo, os métodos essenciais para a era dos agentes:

| Padrão | Exemplo Técnico (Input / Output) | Uso Ideal |

|---|---|---|

| Few-shot | In: “API latency up” / Out: [“latency_issue”] | Garantir estrutura e tom consistentes através de mini-datasets. |

| Chain-of-thought | “Pense passo a passo antes de diagnosticar o erro de DB.” | Tarefas que exigem raciocínio lógico e julgamento complexo. |

| Tool-augmented | “Qual o status do build?” (Integrado a funções de CI/CD). | Conectar o LLM a dados em tempo real e APIs proprietárias. |

O Role Prompting também atua como um modificador de domínio.

Ao definir “Você é um analista focado em Snowflake”, você altera instantaneamente o vocabulário e os pressupostos técnicos do modelo, reduzindo ruídos irrelevantes para aquele contexto.

O Custo Oculto da Modernidade: Latência, Viés e Complexidade

Em 2026, os riscos são claros:

- O Imposto da Rede: Em microserviços, chamadas de rede são ordens de magnitude mais lentas que chamadas in-process. Em fluxos que atravessam múltiplos serviços, a latência acumulada torna-se o gargalo primário.

- O Dilema Ético e Computacional: LLMs trazem vieses inerentes aos dados de treino. A mitigação exige técnicas avançadas como Auditoria de Viés e Privacidade Diferencial (adição de ruído para proteger dados individuais). Além disso, o custo ambiental e computacional do treinamento massivo impõe um limite à eficiência.

A recomendação sênior para 2026 continua sendo: “espere se puder”.

Conclusão: O Futuro é Multimodal e Autônomo

O horizonte aponta para a convergência total: LLMs multimodais integrados nativamente a arquiteturas Serverless e Function-as-a-Service (FaaS).

Essa evolução reduzirá a carga de gerenciamento de infraestrutura, permitindo que os desenvolvedores foquem no que realmente importa: a lógica de agentes autônomos que operam sobre micro-capacidades.

A pergunta provocativa para todo líder de tecnologia hoje é: você está construindo sistemas resilientes e prontos para a era dos agentes de IA, ou está apenas remediando arquiteturas legadas com ferramentas modernas?

[…] e transformando o criador em um mero “intermediário de carne” desnecessário entre o prompt e a […]

[…] desenvolvimento de software agora exige uma disciplina de ferro, mas deslocada da sintaxe para a […]